Deepfake videa: Zneužívají nejen obličeje známých lidí a mohou šířit dezinformace

Deepfake už dávno není jen technologická hříčka pro geeky. V rukou šikovných lidí se z něj stává nástroj, který dokáže změnit realitu. A právě to je důvod, proč nás začíná děsit. Nezůstává totiž jen u celebrit. Míří i na obyčejné lidi jako jsme my.

Dřív platilo, že co je natočené, to je skutečné. Jenže dneska se svět točí trochu jinak. Stačí pár kliknutí a máte video, kde kdokoliv říká cokoliv. Vypadá to přesvědčivě. Pohyby tváře, tón hlasu, všechno sedí. Jenže je to podvrh.

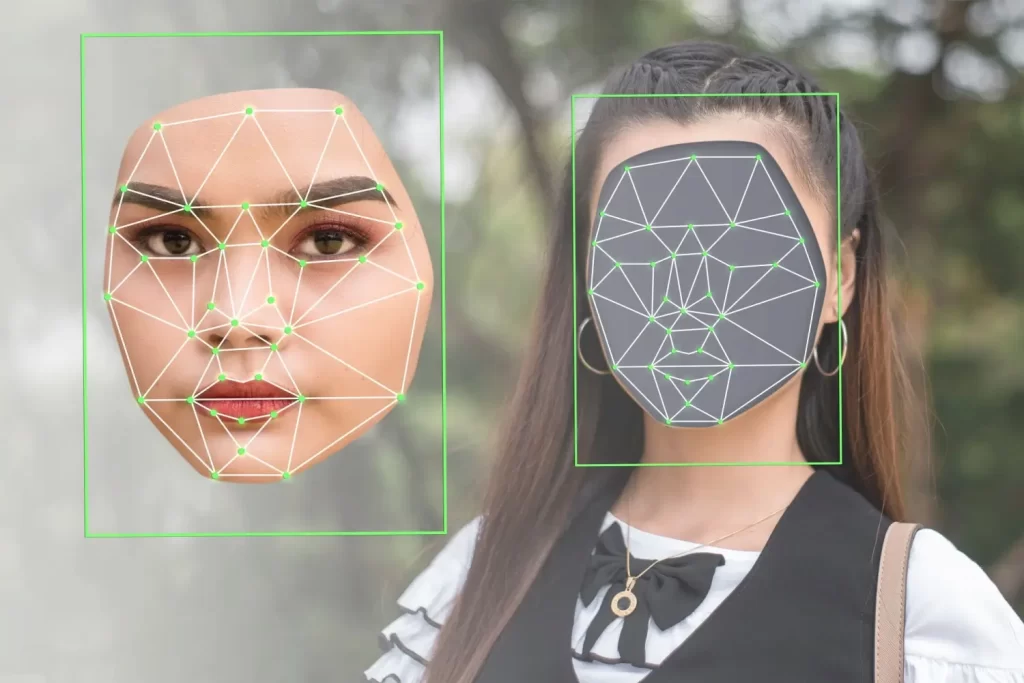

Technologie deepfake funguje na principu umělé inteligence, která vezme obličej a hlas jedné osoby a přenese ho na tělo někoho jiného. Výsledek? Video, které působí naprosto reálně, ale nikdy se nestalo.

Tohle není sci-fi. Tohle je realita dneška. A zatímco někoho baví si s tím hrát, jiní to využívají k manipulaci, vydírání nebo šíření lží.

Známé tváře, ale i sousedka od vedle

Asi nikoho nepřekvapí, že první obětí podobných videí byli slavní lidé. Politici, herci nebo zpěváci se objevovali v záběrech, kde nikdy nebyli, a říkali věci, které nikdy neřekli. Třeba bývalý americký prezident mluvil na videu o věcech, které by nikdy nevyslovil. Vypadalo to reálně, ale nebylo.

Co je ale horší? Že už nejde jen o známé osobnosti. Dnes už se deepfake může týkat kohokoliv z nás. Stačí pár fotek z profilu na sociální síti, k tomu pár vteřin zvukového záznamu a někdo si může vyrobit vaše falešné video.

To video pak může kolovat po internetu a klidně vám zničit reputaci nebo práci. V některých případech i psychiku. A co je nejděsivější? Většina lidí tomu uvěří.

Je to legální nebo už za hranou

Pokud si člověk dělá z deepfaků legraci s kamarády, zákon to neřeší. Ale jakmile tím někoho poškodíte, může to být problém.

Například když někomu nasadíte tvář do erotického videa nebo vytvoříte záznam, kde dotyčný říká něco hanlivého, už to není nevinný vtípek. V tu chvíli vstupují do hry zákony.

V roce 2023 řešili v Hongkongu případ, kde byl díky deepfaku okraden zaměstnanec firmy. Myslel si, že mluví se šéfem, který mu poslal falešné video, a přeposlal mu přes dvacet milionů dolarů. Celé to bylo podvod.

V České republice se takové situace řeší podle trestního zákoníku. Může jít o poškození cizích práv, pomluvu, podvod nebo kyberšikanu.

Jak poznat že jde o deepfake

I když jsou tyhle videa čím dál chytřejší, pořád mají své slabiny.

- Všímejte si očí. Když se ve videu skoro nemrká nebo jsou pohyby očí divné, něco nesedí.

- Zkuste si poslechnout hlas. Pokud je trochu robotický nebo nesedí na pohyb rtů, může to být známka podvrhu.

- Sledujte detaily. Stíny na obličeji, osvětlení nebo nepřirozené barvy pleti často prozradí že je něco špatně.

- Důvěřujte svému instinktu. Pokud máte pocit že je něco divné, většinou máte pravdu.

- Na internetu najdete i nástroje které vám pomůžou ověřit pravost videa. Ale nejlepší je zdravý rozum a schopnost ptát se odkud daný obsah pochází.

Pravda má dneska konkurenci

Doba kdy jsme věřili tomu co vidíme je pryč. A to může být docela problém. Zvlášť ve chvíli, kdy se takový deepfake použije třeba před volbami nebo v mediálních kauzách.

Stačí šikovně vytvořené video a veřejné mínění se otočí. Než se podaří odhalit, že šlo o falešný záznam, je škoda dávno napáchaná.

Deepfake může být nástrojem zábavy, ale mnohem častěji je to prostředek k manipulaci. Proto bychom měli být obezřetní, naučit se ověřovat informace a nenechat se zmást tím, co se tváří jako pravda.

Žijeme v době, kdy si musíme dávat větší pozor

Technologie jde dopředu a s ní i možnosti jak ji zneužít. Deepfake není výjimkou. Dokáže pobavit, ale i ublížit. Může vyvolat smích, ale i zničit život. Právě proto bychom měli být o krok napřed. Nejen sledovat, co se šíří po internetu, ale hlavně přemýšlet.

Svět už nikdy nebude černobílý. Ale pokud budeme dostatečně opatrní, nenecháme se nachytat na líbivá videa, která s pravdou nemají nic společného.

Zdroje: ScienceDirect, Wikipedie, BiometricUpdate.com, Finacial Times